-

原子核裂变的发现深刻地改变了人类社会,一直是核物理研究的一个重要关注点。核裂变数据是很多核技术和核工程应用的重要基础数据[1]。例如在核能、国防、核辐射屏蔽、核废料处理和稀有同位素的生产中,裂变产额均是重要的基础数据。在合成超重元素[2-3],中子星并和过程中的r-process[4],以及反应堆中微子等研究中,核裂变过程也是不可或缺的。特别是高精度的锕系核区的裂变产物产额分布很有应用价值。利用对裂变产物产额的系统分析,还可以进一步认识原子核结构以及核动力学的演化[5-7],但是因为中子不带电,实验上很难给出入射中子能量连续变化的诱发裂变产物产额的实验值。现有个别能量点的实验测量数据但往往不完整。在国际上主流核数据库中,如中国的CENDL[8],美国的ENDF/B-VII.1[9],日本的JENDL-3.3[10],和欧洲的JEFF-3.1.1[11]等,只有在热中子(0.025 eV左右),0.5和14 MeV等三个能量点的中子诱发裂变的完整产额分布。而走向未来的核能—快中子反应堆需要精确的能量相关的裂变数据。因此对未知的不同中子能量的裂变产额进行高精度的预测和评价是非常急需的。

原子核裂变过程是一种复杂的量子多体系统的大幅度集体运动,对核裂变可观测量的精确描述仍是核物理最具有挑战性的课题之一[12]。发展时间相关的微观裂变动力学模型(Time- Dependent- Hartree-Fock- Bogoliubov[13]和Time-Dependent-Generate-Coordinate-Method[14-15])可以更好地理解裂变机制,但离定量计算还有较大的距离。虽然准微观的裂变模型可以与某些原子核的现有实验数据符合得很好[16],但裂变模式也会随质子数中子数的不同而演化。所以准微观裂变模型和唯像裂变模型的预测能力很有限。裂变可观测量的计算主要取决于复杂的多维的势能面[12]。随着激发能的增加,复合核裂变所涉及的量子效应逐渐减弱[3, 17]。因此对复合核裂变产物的产额[17-18]和发射中子后裂变产物的产额[19]的能量依赖关系的描述将更为复杂。此外,针对核理论模型的不确定性的量化研究是近年来很受关注的问题[20]。

目前人工智能与不同学科的交叉融合获得了广泛的成功和关注。在学习复杂的大数据并作出预测方面,机器学习是一个强有力的工具。神经网络深度学习[21]是机器学习的一个分支,通过构造多层神经网络来训练大量数据,可以模拟复杂的物理关联。传统的神经网络很难给出预测结果的不确定性,而贝叶斯神经网络(BNN)的网络连接参数为概率分布,能够自然地给出逆向回归问题的不确定度[22]。对于不同激发能的核裂变产物产额,有大量的但不完整的实验测量数据。因此,BNN是描述复杂的裂变观测量和分析复合核裂变统计特性的理想工具。近年来BNN已被广泛用于核物理,包括预测远离稳定线核区的结合能[22-25],模拟核反应截面[26-27],状态方程[28]以及高能核核碰撞[29]等。虽然高斯过程也可以求解回归问题,但侧重于局部关联[22]。而传统的核裂变评价模型,如Brosa模型[30]等,主要基于唯像模型的参数拟合[31]。这种评价方法,在实验数据点很少的时候可能不适用,且不能给出不确定度分析。本文的主要目的是提出基于BNN方法对不完整裂变产物进行评价[32],展示BNN在描述裂变碎片产额上的初步能力,比较不同BNN结构的差异。BNN通过学习复杂的裂变数据进行预测和分析,有可能包含目前裂变理论模型之外的潜在关联,从而揭示在裂变过程中一些新的机制。

-

BNN将神经网络权重参数设定为概率分布[33],而不是传统神经网络设定的固定数值。BNN将网络参数的概率函数视作先验分布,利用贝叶斯公式训练后得到后验分布,通过后验分布对多维的网络权重参数进行马尔科夫链-蒙特卡洛积分,得到预测均值和不确定度。通过对给定的训练样本数据进行有限的训练步骤,BNN可以对包含预测均值的预测概率分布分析得到置信区间,从而可以定量描述不确定性。BNN还可以对特定问题采用不同的先验分布,从而引入惩罚函数避免过拟合问题。另一方面,与贝叶斯统计不同的经典统计的目的是通过无限次采样后获得精确的参数值。

BNN模型采用的前向神经网络的网络函数为

$$f(x,\theta ) = a + \sum\limits_{j = 1}^H {{b_j}\tanh \left( {{c_j} + \sum\limits_{i = 1}^l {{d_{ij}}{x_i}} } \right)} {\rm{ ,}}$$ (1) 其中:

$H$ 为隐藏层神经元个数;$l$ 为网络中输入参数个数;$\theta = \left\{ {a,{b_j},{c_j},{d_{ij}}} \right\}$ 为模型参数集。该公式描述了单隐藏层的神经网络。对于多层神经网络,每层的输入${x_i}$ 都是下一层的网络函数的输出。根据数据集的规模来确定神经元的个数,进而决定了网络的复杂性。目前模型采用了一层隐藏层,为了尽量避免在复杂网络中有的网络参数未被激活利用。网络的输入数据集为${x_i} = \{ {Z_i}, $ $ {N_i},{A_i},{E_i} \}$ ,其中${Z_i}$ 为裂变核的电荷数;${N_i}$ 为裂变核的中子数;${A_i}$ 为裂变碎片的质量数;${E_i} = {e_i} + {S_i}$ 为复合核的激发能(其中${e_i}$ 和${S_i}$ 分别是中子入射能量和中子分离能)。选择裂变核的激发能作为输入可以与激发能为0的自发裂变进行区别。网络模型输出每个碎片的独立产额而不是所有产额的分布,但是总的裂变产额在2%的误差内非常接近总产额的归一化的期望值2.0。因此总产额的归一化不存在问题,采用后验归一化已经足够好。BNN网络的似然函数$p\left( {\left. D \right|\theta } \right)$ 和目标函数${\chi ^2}$ 由下式给出:$$\begin{split}&p\left( {\left. D \right|\theta } \right) = \exp \left( { - {\chi ^2}/2} \right),\\&{\chi ^2} = \sum\limits_i^N {{{\left[ {{t_i} - f\left( {{x_i},\theta } \right)} \right]}^2}/\Delta t_i^2,} \end{split}$$ (2) 其中

$D = \{ {x_i},{t_i}\} $ 网络数据;${x_i}$ 为输入数据;${t_i}$ 为输出裂变产额;$\Delta {t_i}$ 为对应的噪声强度[22-23, 25]。后验分布$p\left( {\theta \left| {x,t} \right.} \right)$ 可由下式得到:$$p\left( {\left. \theta \right|D} \right) = \frac{{p\left( {\left. D \right|\theta } \right)p\left( \theta \right)}}{{\int {p\left( {\left. D \right|\theta } \right)p\left( \theta \right){\rm{d}}\theta } }},$$ (3) 其中

$p\left( \theta \right)$ 为设定的先验参数分布[33],一般采用高斯分布。网络参数学习实际上是一个应用随机梯度朗之万动力学方法,采样搜索后验分布的极大值的过程[30]。随机梯度朗之万动力学方法,即在梯度下降算法的基础上,在导数中加入期望值为0并与学习速率相关的噪声项。基于给定的网络函数$f\left( {{x_n},\theta } \right)$ 可以得到新输入数据${x_n}$ 的预测结果。由于网络函数是一个概率分布,BNN网络的均值预测涉及高维积分,可以使用马尔可夫链-蒙特卡洛采样积分得到:$$\left\langle {f\left( {{x_n},\theta } \right)} \right\rangle = \int {f\left( {{x_n},\theta } \right)p\left( {\theta \left| D \right.} \right){\rm{d}}\theta } {\text{。}}$$ (4) 当进一步加入新的实验数据

${D_n}$ 时,后验分布可以依据下式更新:$$p\left( {\theta \left| {D,{D_n}} \right.} \right) = \frac{{p\left( {{D_n}\left| \theta \right.} \right)p\left( {\theta \left| D \right.} \right)}}{{\int {p\left( {{D_n}\left| \theta \right.} \right)p\left( {\theta \left| D \right.} \right){\rm{d}}\theta } }},$$ (5) 通过对后验分布的更新,可以对新的不完整的实验数据进行评价。

-

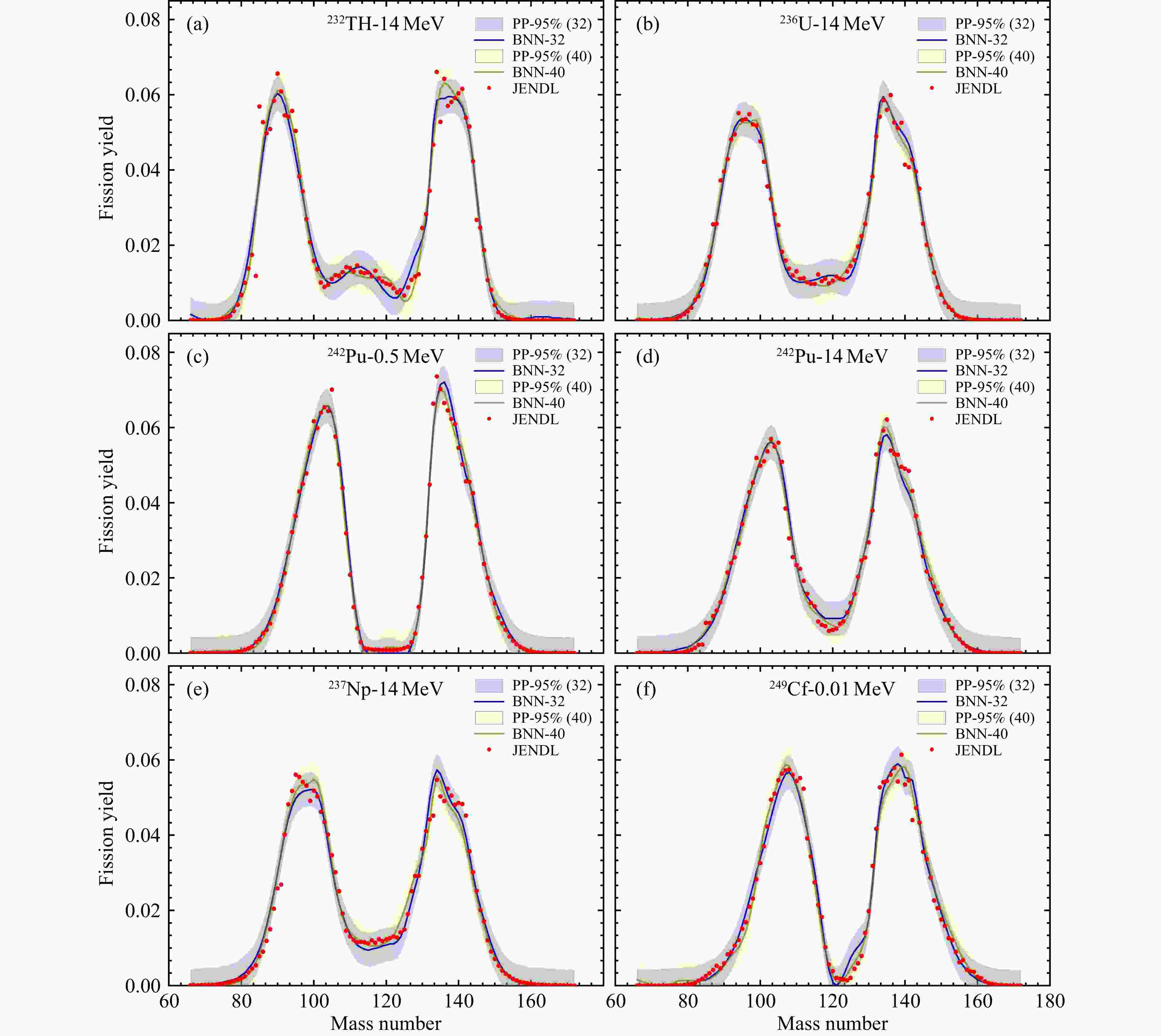

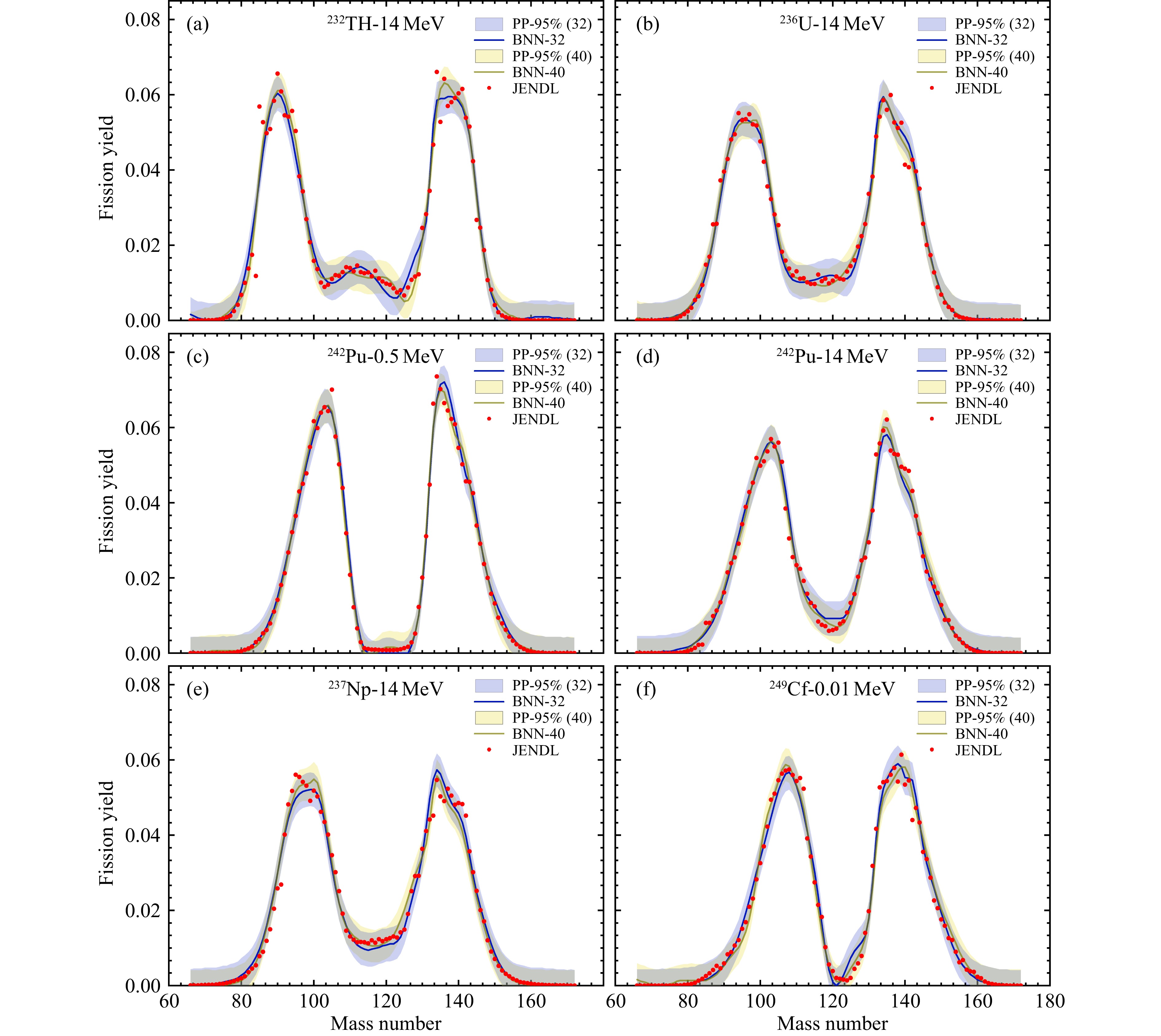

为了训练BNN模型,我们首先将日本的JENDL核数据库[10]中的30个核(例如227,229,232Th,231Pa,232,233,234,235,236,237,238U,237,238Np,238,239,240,241,242Pu,241,243Am,242,243,244,245,246,248Cm,249,251Cf,254Es,255Fm)的中子诱发裂变数据加入训练数据集中。BNN网络训练的总误差定义为

$\chi _N^2 = \sum\nolimits_i {{{\left[ {{t_i} - f({x_i})} \right]}^2}} /N$ 。一般认为全局优化和过拟合是神经网络模型中的两个最具有挑战性的问题。复杂网络结构的BNN可能存在训练的数值收敛问题[22]。BNN模型需要足够的采样训练来达到数值收敛,这将耗费较长的运算时间。神经网络对包含30个核的5 350个数据点的训练数据集分别应用了32个和40个神经元的隐藏层。该训练数据量大于应用在原子核质量的BNN模型的数据量[22-23, 25]。本文所有的网络训练均应用了100 000次采样学习。图1给出BNN网络的部分训练结果。从图中可以看出,BNN模型的训练结果基本上重现了裂变产额的分布,给出了正确的裂变产额的位置分布和能量依赖特征。对于不同核,BNN模型也给出了不同裂变模式,236U,242Pu和237Np均能很好地重现实验值。其原因是训练数据集中包含了U和Pu各同位素的数据。同样可以注意到,232Th和249Cf的训练结果略有偏离,这是因为训练数据集中这些核的邻近核的裂变数据比较少。图1显示训练结果对应的95%置信区间比较小,可以合理反映BNN模型的描述能力。除了训练数据集以外,神经网络的架构也可能影响模型的性能。图1也给出了隐藏层分别为32神经元和40神经元的BNN模型的训练结果的对比。40神经元在质量数为125~135的附近有较好表现。采用40神经元的95%置信区间没有明显减小。总体上,40神经元训练结果与32神经元训练结果并没有显著差距。在本文的网络架构下,随着隐藏层神经元数量上升,BNN方法所需的运算时间增加,而且可能导致预测值会有更大的不确定性。进一步,表1给出不同模型方法的验证能力的对比。表1中包含了应用TALYS程序的结果,包含Brosa和GEF模型的TALYS程序被广泛应用于裂变数据的评估。基于发展物理模型与神经网络融合的目的,我们采用了TALYS-1.9中GEF模型计算的初始裂变产额,使用BNN模型学习其残差。表1的结果表明BNN模型较TALYS程序有大幅度改进,然而由于TALYS程序的误差很大,结合TALYS程序的BNN模型比仅使用BNN的模型并没有明显变好的结果。目前我们正在研究多隐藏层的BNN,采用双隐藏层的BNN结果对比单隐藏层结果会有明显的改善。但值得一提的是,BNN结合微观核质量模型是十分成功的[22-23, 25],因此可以展望未来BNN结合微观裂变模型能够有很好的预测能力。

表 1 不同网络模型的验证结果的误差

模型 ${\chi ^2}/{10^{ - 5}}$ BNN-32 0.670 BNN-40 0.629 BNN-32+TALYS 1.902 BNN-40+TALYS 1.139 TALYS 16.79 注:表中BNN-32表示模型隐藏层包含32个神经元,TALYS结果由TALYS-1.9中GEF模型在默认参数下的计算得到。 -

应用BNN模型的关键动机,是在学习现有完整裂变产额实验数据的基础上,对特定核不完整裂变产额的实验数据进行评价,并推断出完整的裂变产额。在学习JENDL的裂变产额数据后,BNN模型对235U,238U,239Pu在部分能量中子诱发下的不完整实验数据[33]的评估结果由图2给出。现有数据库中没有相应的完整评估。从图2(c)和(e)可以发现,在包括了这些实验数据后[33],BNN模型可以对裂变产额给出相当合理的完整评估。这可以部分归因于1.37 MeV的能量颇为接近训练数据集中已经包含的0.5 MeV能量的数据。而当能量处于0.5和14 MeV之间时,完整评价是具有挑战性的。如图2(b),(d)和(f)所示,BNN在远离0.5 MeV能量处的评估结果也比较合理。观察图2(c),评估结果在质量数为110附近存在不合理的裂变产额分布接近负值,但包括不完整的实验数据点后,负值问题可以被避免。此外通过加入惩罚约束也可以避免负值问题。

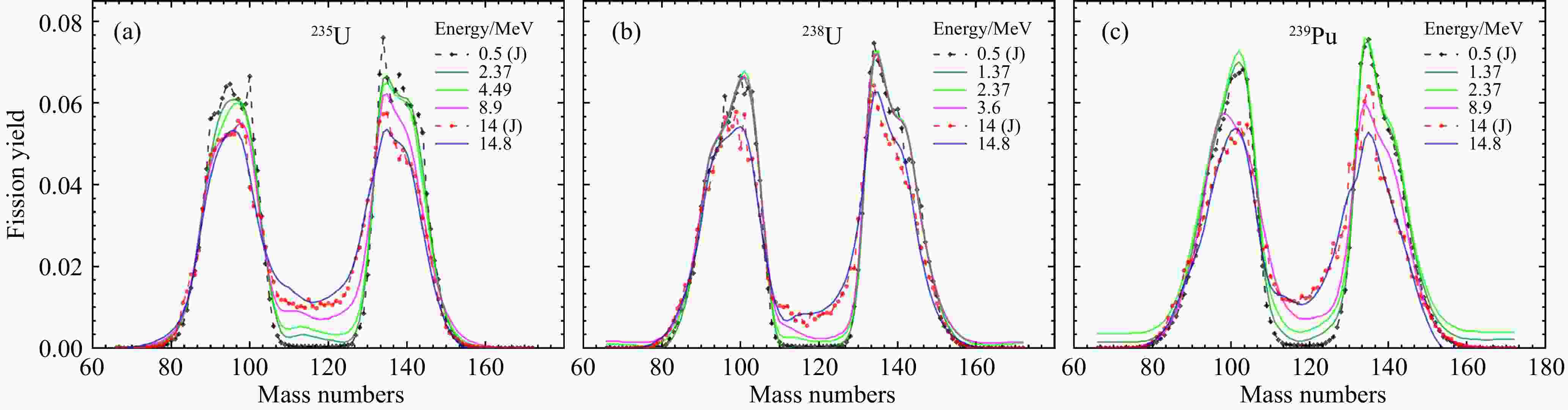

基于不同能量中子诱发裂变的不完整实验数据的评价,图3给出235U,238U,239Pu在不同能量的不完整实验数据的评估汇总。分别包含235U在2.37,4.49,8.9,14.8 MeV,238U在1.37,2.37,3.6,14.8 MeV和239Pu在1.37,2.37,8.9,14.8 MeV时的中子激发能评估曲线。可以注意到,在质量数为110~130附近的谷底,裂变产额随着能量单调上升。同时,随着激发能量的上升,非对称裂变模式对应的两个峰值也逐渐减小。一般认为,随着激发能的增加,对称裂变模式将逐渐占据主导,非对称裂变模式逐渐减退[17-18, 34]。因此可以说明,BNN评价基本上合理地描述了裂变产额能量依赖的特征。

总体上BNN评价可以合理地给出置信区间作为不确定性的度量。BNN方法预测裂变产额的峰值分布位置是可靠的。虽然峰值附近的细致结构并不十分精确,但BNN方法对于单个核裂变的细致结果是精确的。通常,裂变产额是通过唯象模型来评估的,而唯象模型在只有少数实验数据点可用的情况下是无法可靠应用的,且无法给出不确定度。在这方面,BNN方法对有较大误差和有分歧的实验数据进行融合评价和进行量化误差分析有独特的优势。另外,通过在学习集中加入更多的实验测量数据,并优化神经网络的结构,可以进一步改进目前的网络模型。也可以引入其他辅助的物理量,例如,电荷分布的奇偶效应和壳效应等来进一步改进神经网络。最近我们基于改进的BNN对239U复合核裂变的电荷产额进行了推断,得到了可以与GEF模型相比较的高精度的评价数据[35]。在未来可以融合微观裂变模型或者利用先验物理规律指导神经网络也是值得期待的。

-

本文应用BNN模型来研究和评价锕系区原子核在不同入射中子能量下的诱发裂变产额,这是一个新的方向。在很多情况下,中子诱发裂变产额分布的实验数据是不完整的。基于所获得的信息,对不完整的裂变产额数据进行BNN评价有广泛的应用前景。对裂变产额的分布位置和能量依赖关系,BNN的结果是令人满意的,而唯象评价模型在实验数据很少的情况下很难应用。此外,贝叶斯神经网络模型可以自然地给出置信区间来合理地估计预测的不确定性。今后我们将应用多隐藏层的BNN,发展与微观裂变模型的融合,评价其他的裂变观测量,以及分析裂变后的各种观测量之间的关联为发展裂变理论提供线索。BNN模型的进一步改进可以在未来提供更可靠和更精确的核裂变数据的评价,有望满足核能和核工程领域对应用级核数据的实际需求。

-

摘要: 核裂变碎片的产额是核能和核应用领域中的关键基础数据。在实验和理论上,获得精确且完整的能量依赖的裂变产额到目前为止都是一个挑战。贝叶斯神经网络(Bayesian Neural Networks,BNN)可以描述需要量化不确定性的逆向回归问题。基于BNN学习已有的裂变产额,可以给出未知的裂变产额及其不确定度。特别是当裂变产物产额的实验数据不完整时,BNN可以推断出完整的裂变产额。在裂变产额的质量分布和能量依赖关系上,BNN的评价结果比较合理。研究结果表明BNN在核数据评价领域有广泛的应用前景。Abstract: Nuclear fission data are important infrastructure data in nuclear applications and nuclear engineering. It is still challenging to obtain accurate and complete energy-dependent fission yields in experiments and theories. Bayesian Neural Network (BNN) is idea to treat inverse regression problems and can provide quantified uncertainties. We apply BNN to infer fission yields based on learning of existing fission yields. In particular, BNN is very useful for evaluations of fission yields when incomplete experimental data are available. We demonstrated that the BNN evaluations are quite satisfactory on mass distributions and energy dependencies of fission yields. This indicates that BNN is very promising in nuclear data community.

-

Key words:

- nuclear fission /

- bayesian neural networks /

- fission yields

-

图 2 (在线彩图)235U, 238U, 239Pu在部分能量中子诱发裂变的不完整实验数据的评估结果

阴影部分给出评估结果的95%置信区间。实验数据及其误差棒取自文献[33]。

图 3 (在线彩图)235U, 238U, 239Pu在不同能量中子诱发裂变产额的不完整实验数据的评价结果

其中0.5V和14 MeV能量的实验数据取自JENDL[10]。

表 1 不同网络模型的验证结果的误差

模型 ${\chi ^2}/{10^{ - 5}}$ BNN-32 0.670 BNN-40 0.629 BNN-32+TALYS 1.902 BNN-40+TALYS 1.139 TALYS 16.79 注:表中BNN-32表示模型隐藏层包含32个神经元,TALYS结果由TALYS-1.9中GEF模型在默认参数下的计算得到。 -

[1] BERNSTEIN L, BROWN D, HURST A, et al. arXiv: 1511.07772[nucl-ex]. [2] HAMILTON J H, HOFMANN S, OGANESSIAN Y T, et al. Annu Rev Nucl Part Sci, 2013, 63: 383. doi: 10.1146/annurev-nucl-102912-144535 [3] PEI J C, NAZAREWICZ W, SHEIKH J A, et al. Phys Rev Lett, 2009, 102: 192501. doi: 10.1103/PhysRevLett.102.192501 [4] EICHLER M, ARCONES A, KELIC A, et al. Astrophys J, 2015, 808: 30. doi: 10.1088/0004-637X/808/1/30 [5] ITKIS M G, VARDACI E, ITKIS I M, et al. Nucl Phys A, 2015, 944: 204. doi: 10.1016/j.nuclphysa.2015.09.007 [6] ANDREYEV A N, NISHIO K, SCHMIDT K H. Rep Prog Phys, 2018, 81(1): 016301. doi: 10.1088/1361-6633/aa82eb [7] SCAMPS G, SIMENEL C. Phys Rev C, 2019, 100: 041602. doi: 10.1103/PhysRevC.100.041602 [8] GE Z G, ZHAO Z X, XIA H H, et al. J Korean Phys Soc, 2011, 59: 1052. doi: 10.3938/jkps.59.1052 [9] CHADWICK M B, HERMAN M, OBLOZINSKY P, et al. Nuclear Data Sheets, 2011, 113(12): 2887. doi: 10.1016/j.nds.2011.11.002 [10] SHIBATA K, IWAMOTO O, NAKAGAWA T, et al. Journal of Nuclear Science and Technology, 2011, 48: 1. doi: 10.1080/18811248.2011.9711675 [11] Joint Evaluated Fission and Fusion (JEFF) Nuclear Data Library[EB/OL]. [2020-04-15]. https://www.oecd-nea.org/dbdata/jeff/. [12] SCHUNCK N, ROBLEDO L M. Rep Prog Phys, 2016, 79(11): 116301. doi: 10.1088/0034-4885/79/11/116301 [13] PEI J C. Science China Physics, Mechanics & Astronomy, 2020, 50(5): 052004. [14] REGNIER D, DUBRAY N, SCHUNCK N, et al. Phys Rev C, 2016, 93: 054611. doi: 10.1103/PhysRevC.93.054611 [15] YOUNES W, GOGNY D, BERGER J F. A Microscopic Theory of Fission Dynamics Based on the Generator Coordinate Method[M]. Cham, Switzerland: Springer Nature Switzerland AG, 2019: 950. [16] SCHMIDT K H, JURADO B. Rep Prog Phys, 2018, 81: 106301. doi: 10.1088/1361-6633/aacfa7 [17] RANDRUP J, MOLLER P. Phys Rev C, 2013, 88: 064606. doi: 10.1103/PhysRevC.88.064606 [18] ZHAO J, NIKSIC T, VRETENAR D, et al. Phys Rev C, 2019, 99: 014618. doi: 10.1103/PhysRevC.99.014618 [19] OKUMURA S, KAWANO T, JAFFKE P, et al. J Nucl Sci Technol, 2018, 55(9): 1009. doi: 10.1080/00223131.2018.1467288 [20] MCDONNELL J D, SCHUNCK N, HIGDON D, et al. Phys Rev Lett, 2015, 114: 122501. doi: 10.1103/PhysRevLett.114.122501 [21] LECUN Y, BENGIO Y, HINTON G. Nature, 2015, 521: 436. doi: 10.1038/nature14539 [22] NEUFCOURT L, CAO Y C, NAZAREWICZ W, et al. Phys Rev C, 2018, 98: 034318. doi: 10.1103/PhysRevC.98.034318 [23] NIU Z M, LIANG H Z. Phys Lett B, 2018, 778: 48. doi: 10.1016/j.physletb.2018.01.002 [24] ZHANG H F, WANG L H, YIN J P, et al. J Phys G, 2017, 44: 045110. doi: 10.1088/1361-6471/aa5d78 [25] UTAMA R, PIEKAREWICZ J, PROSPER H B. Phys Rev C, 2016, 93: 014311. doi: 10.1103/PhysRevC.93.014311 [26] TALOU P, YOUNG P G, KAWANO T, et al. Nucl Data Sheets, 2011, 112(12): 3054. doi: 10.1016/j.nds.2011.11.005 [27] MA C W, PENG D, WEI H L, et al. Chin Phys C, 2020, 44: 014104. doi: 10.1088/1674-1137/44/1/014104 [28] PRATT S, SANGALINE E, SORENSEN P, et al. Phys Rev Lett, 2015, 114: 202301. doi: 10.1103/PhysRevLett.114.202301 [29] PANG LG, ZHOU K, SU N, et al. Nature Comm, 2018, 9: 210. doi: 10.1038/s41467-017-02726-3 [30] BROSA U, GROSSMANN S, MULLER A. Phys Rep, 1990, 197(4): 167. doi: 10.1016/0370-1573(90)90114-H [31] ENGLAND T R, RIDER B F. Evaluation and compilation of fission product yields 1993[R]. Los Alamos National Laboratory Report, 1993, LA-SUB-94-170. [32] WANG Z A, PEI J, LIU Y, et al. Phys Rev Lett, 2019, 123: 122501. doi: 10.1103/PhysRevLett.123.122501 [33] NEAL R M. Bayesian Learning for Neural Networks[M]. New York: Springer, 1996. [34] SHEIKG J A, NAZAREWICZ W, PEI J C. Phys Rev C, 2009, 80: 011302. doi: 10.1103/PhysRevC.80.011302 [35] QIAO C Y, PEI J C, WANG Z A, et al. arXiv: 2102.09314. -

下载:

下载:

甘公网安备 62010202000723号

甘公网安备 62010202000723号